已解决

Spark任务优化分析

来自网友在路上 160860提问 提问时间:2023-10-14 18:32:27阅读次数: 60

最佳答案 问答题库608位专家为你答疑解惑

一、背景

首先需要掌握 Spark DAG、stage、task的相关概念

Spark的job、stage和task的机制论述 - 知乎

task数量和rdd 分区数相关

二、任务慢的原因分析

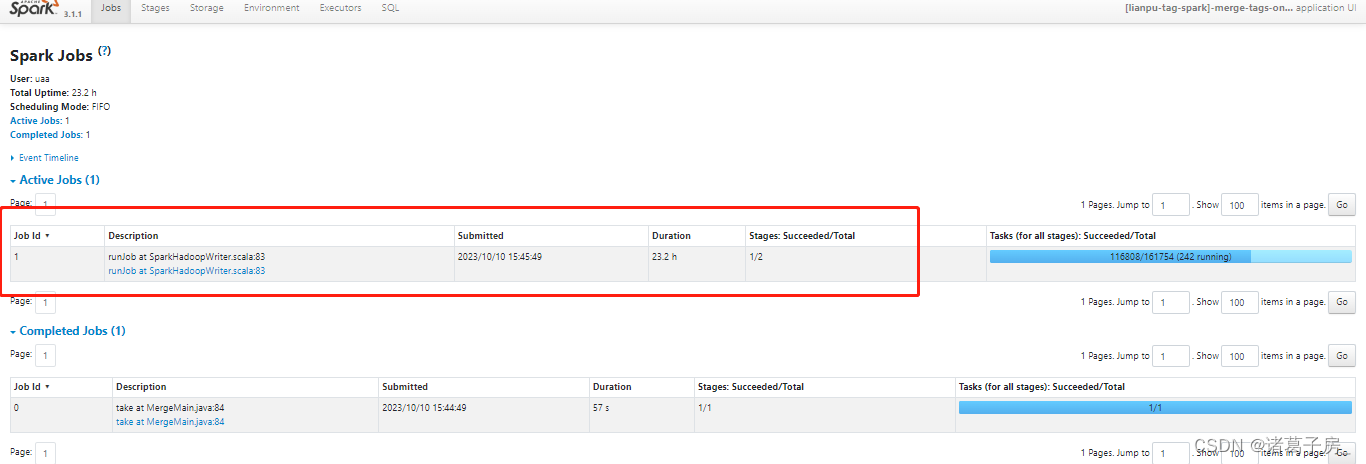

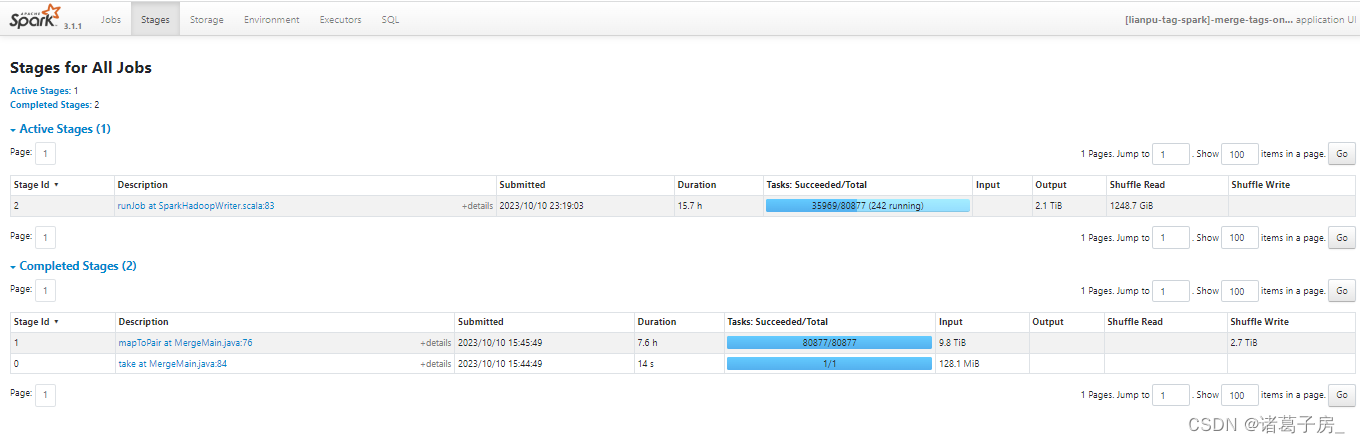

找到运行时间比较长的stage

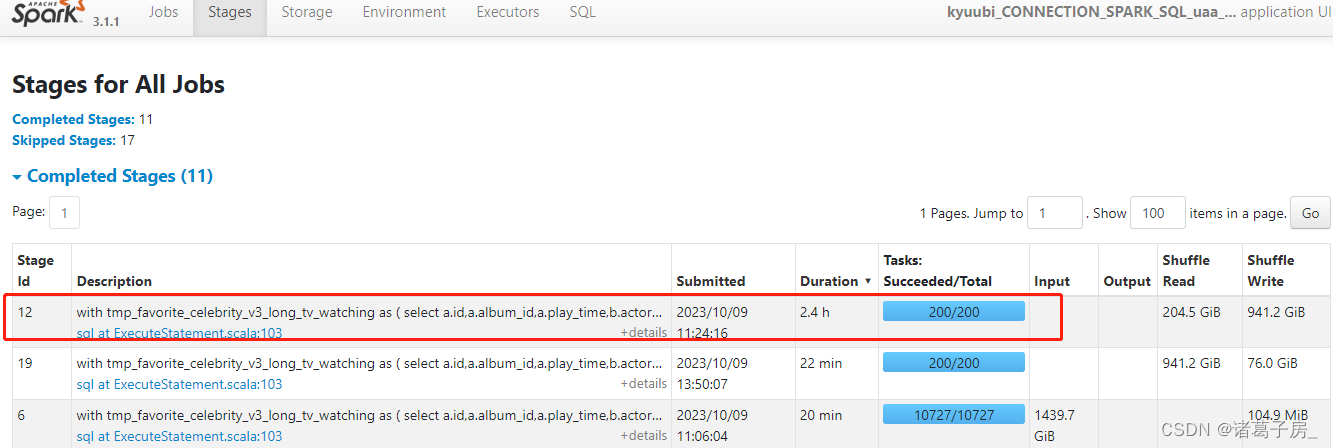

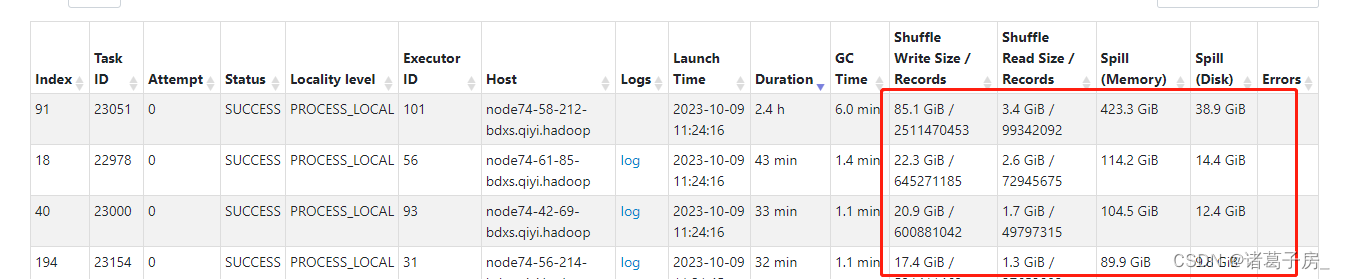

再进去看里面的task

可以看到某个task 读取的数据量明显比其他task 较大。

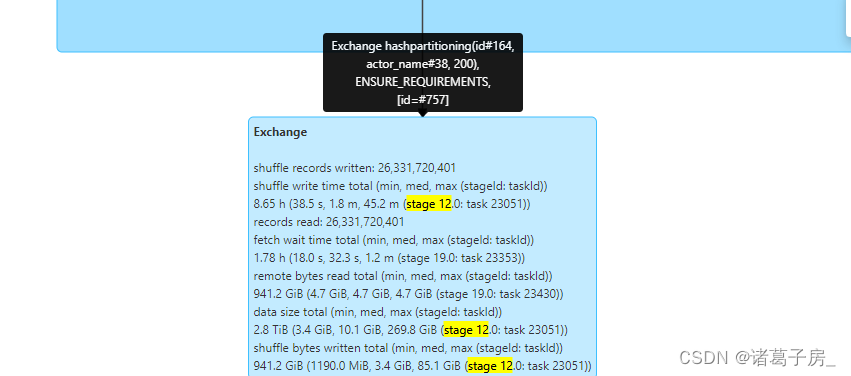

如果是sql 任务进入到 SQL 页面看到 对应的执行卡在哪里,然后分析,如下图是hash id、actor_name,可以看到是group by 数据有倾斜。

group by 数据倾斜问题,可以参考hive group by 数据倾斜问题同样处理思路。

https://zhugezifang.blog.csdn.net/article/details/127447167

查看全文

99%的人还看了

相似问题

猜你感兴趣

版权申明

本文"Spark任务优化分析":http://eshow365.cn/6-19500-0.html 内容来自互联网,请自行判断内容的正确性。如有侵权请联系我们,立即删除!

- 上一篇: spring boot 使用SSE向前端推送数据

- 下一篇: idea自动封装方法