已解决

人工智能基础_机器学习013_三种梯度下降对比_线性回归梯度下降更新公式_对梯度下降函数求偏导数_得到---人工智能工作笔记0053

来自网友在路上 166866提问 提问时间:2023-11-01 15:41:47阅读次数: 66

最佳答案 问答题库668位专家为你答疑解惑

这里批量梯度下降,就是用准备的所有样本数据进行梯度下降计算.

然后小批量梯度下降就是使用比如我一共有500个样本,那么我从中拿出50个样本进行梯度下降计算.

然后随机梯度下降,更厉害, 从一共有500个样本中,随机的取一个样本进行梯度下降计算,

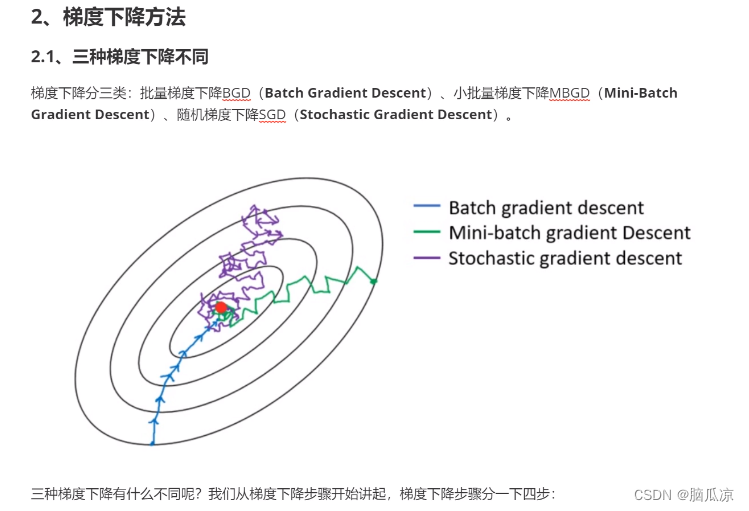

首先我们看批量梯度下降,使用所有样本数据,可以看到是蓝色的走的比较规律,最终得到最优解

然后小批量梯度下降是绿色的,可以看到因为用了一部分样本所以,走的比较乱,但是最终也到了最优解.

然后随机梯度下降,因为只有一个样本数据,所以数据量小,那么他走的就可以看到,来回拐弯,最终也会收敛.就像是森林中迷路,只要沿着一条小河走,最终都会走出去一样.

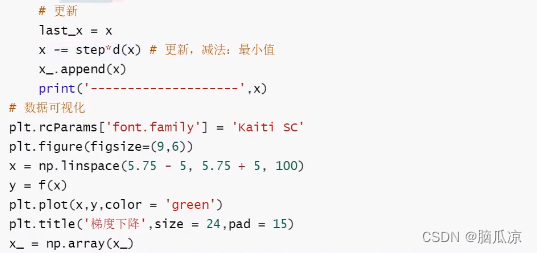

上面是上一节我们做梯度下降,自己写的代码,可以回顾一下,过程

然后我们来看一下具体写出来随机梯度下降的过程,其实就是

1.随机生成一个seta,或者随机一组seta 这个seta其实就是,对应的多元一次方程的,对应的w0...wn

2.然后生成了seta以后,求seta位置对应的梯度g,g代表斜率

查看全文

99%的人还看了

相似问题

- PyTorch多GPU训练时同步梯度是mean还是sum?

- 梯度引导的分子生成扩散模型- GaUDI 评测

- 【机器学习】038_梯度消失、梯度爆炸

- 斯坦福机器学习 Lecture2 (假设函数、参数、样本等等术语,还有批量梯度下降法、随机梯度下降法 SGD 以及它们的相关推导,还有正态方程)

- 吴恩达《机器学习》6-4->6-7:代价函数、简化代价函数与梯度下降、高级优化、多元分类:一对多

- 深入理解强化学习——多臂赌博机:梯度赌博机算法的基础知识

- 利用梯度上升可视化卷积核:基于torch实现

- Pytorch里面参数更新前为什么要梯度手动置为0?

- LSTM缓解梯度消失问题

- 前馈神经网络自动梯度计算和预定义算子

猜你感兴趣

版权申明

本文"人工智能基础_机器学习013_三种梯度下降对比_线性回归梯度下降更新公式_对梯度下降函数求偏导数_得到---人工智能工作笔记0053":http://eshow365.cn/6-29420-0.html 内容来自互联网,请自行判断内容的正确性。如有侵权请联系我们,立即删除!