已解决

李沐深度学习记录5:13.Dropout

来自网友在路上 179879提问 提问时间:2023-10-06 16:44:13阅读次数: 79

最佳答案 问答题库798位专家为你答疑解惑

Dropout从零开始实现

import torch

from torch import nn

from d2l import torch as d2l# 定义Dropout函数

def dropout_layer(X, dropout):assert 0 <= dropout <= 1# 在本情况中,所有元素都被丢弃if dropout == 1:return torch.zeros_like(X)# 在本情况中,所有元素都被保留if dropout == 0:return X#torch.rand生成0-1之间的均匀分布随机数,将其值与dropout概率作比较,得到布尔类型结果由mask存储#布尔类型为0的则为随机丢弃置0的隐藏层单元,留下的则进行值的替换h-->h/(1-p)mask = (torch.rand(X.shape) > dropout).float()return mask * X / (1.0 - dropout)# 测试dropout函数

# X= torch.arange(16, dtype = torch.float32).reshape((2, 8))

# print(X)

# print(dropout_layer(X, 0.))

# print(dropout_layer(X, 0.5))

# print(dropout_layer(X, 1.))#定义模型参数

num_inputs, num_outputs, num_hiddens1, num_hiddens2 = 784, 10, 256, 256#定义模型

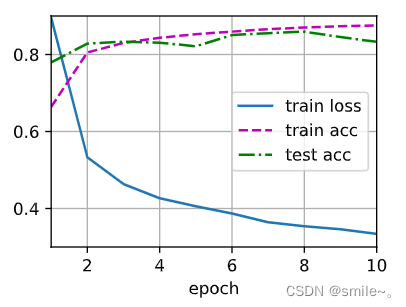

dropout1, dropout2 = 0.2, 0.5class Net(nn.Module): #写一个模型类继承nn.Moduledef __init__(self, num_inputs, num_outputs, num_hiddens1, num_hiddens2,is_training = True):super(Net, self).__init__()self.num_inputs = num_inputsself.training = is_training#定义三个全连接层和激活函数self.lin1 = nn.Linear(num_inputs, num_hiddens1)self.lin2 = nn.Linear(num_hiddens1, num_hiddens2)self.lin3 = nn.Linear(num_hiddens2, num_outputs)self.relu = nn.ReLU()def forward(self, X):H1 = self.relu(self.lin1(X.reshape((-1, self.num_inputs)))) #第一层全连接层加激活函数# 只有在训练模型时才使用dropoutif self.training == True:# 在第一个全连接层之后添加一个dropout层H1 = dropout_layer(H1, dropout1)H2 = self.relu(self.lin2(H1))if self.training == True:# 在第二个全连接层之后添加一个dropout层H2 = dropout_layer(H2, dropout2)out = self.lin3(H2)return outnet = Net(num_inputs, num_outputs, num_hiddens1, num_hiddens2)#训练和测试

num_epochs, lr, batch_size = 10, 0.5, 256

loss = nn.CrossEntropyLoss(reduction='none')

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)

trainer = torch.optim.SGD(net.parameters(), lr=lr)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

Dropout简洁实现

import torch

from torch import nn

from d2l import torch as d2l#定义模型参数

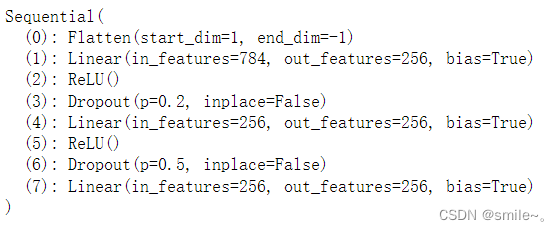

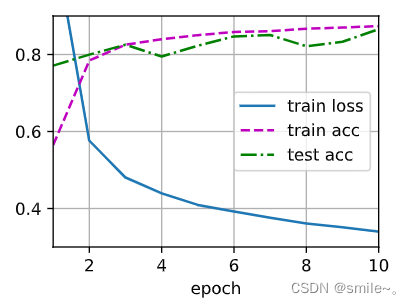

num_inputs, num_outputs, num_hiddens1, num_hiddens2 = 784, 10, 256, 256#定义模型

dropout1, dropout2 = 0.2, 0.5#定义模型

net=nn.Sequential(nn.Flatten(),nn.Linear(784,256),nn.ReLU(),#第一个全连接层之后添加一个Dropout层nn.Dropout(dropout1),nn.Linear(256,256),nn.ReLU(),#第二个全连接层之后添加一个Dropout层nn.Dropout(dropout2),nn.Linear(256,10))

#参数初始化

def init_weights(m):if type(m)==nn.Linear:nn.init.normal_(m.weight,std=0.01)net.apply(init_weights)

#读取数据

batch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)#训练测试

num_epochs,lr=10,0.5

loss = nn.CrossEntropyLoss(reduction='none')

trainer=torch.optim.SGD(net.parameters(),lr=lr)

d2l.train_ch3(net,train_iter,test_iter,loss,num_epochs,trainer)

查看全文

99%的人还看了

相似问题

- 最新AIGC创作系统ChatGPT系统源码,支持最新GPT-4-Turbo模型,支持DALL-E3文生图,图片对话理解功能

- 思维模型 等待效应

- FinGPT:金融垂类大模型架构

- 人工智能基础_机器学习044_使用逻辑回归模型计算逻辑回归概率_以及_逻辑回归代码实现与手动计算概率对比---人工智能工作笔记0084

- Pytorch完整的模型训练套路

- Doris数据模型的选择建议(十三)

- python自动化标注工具+自定义目标P图替换+深度学习大模型(代码+教程+告别手动标注)

- ChatGLM2 大模型微调过程中遇到的一些坑及解决方法(更新中)

- Python实现WOA智能鲸鱼优化算法优化随机森林分类模型(RandomForestClassifier算法)项目实战

- 扩散模型实战(十一):剖析Stable Diffusion Pipeline各个组件

猜你感兴趣

版权申明

本文"李沐深度学习记录5:13.Dropout":http://eshow365.cn/6-16382-0.html 内容来自互联网,请自行判断内容的正确性。如有侵权请联系我们,立即删除!

- 上一篇: c语言tips-宏连接

- 下一篇: 数据集笔记:OpenCelliD(手机基站开放数据库)